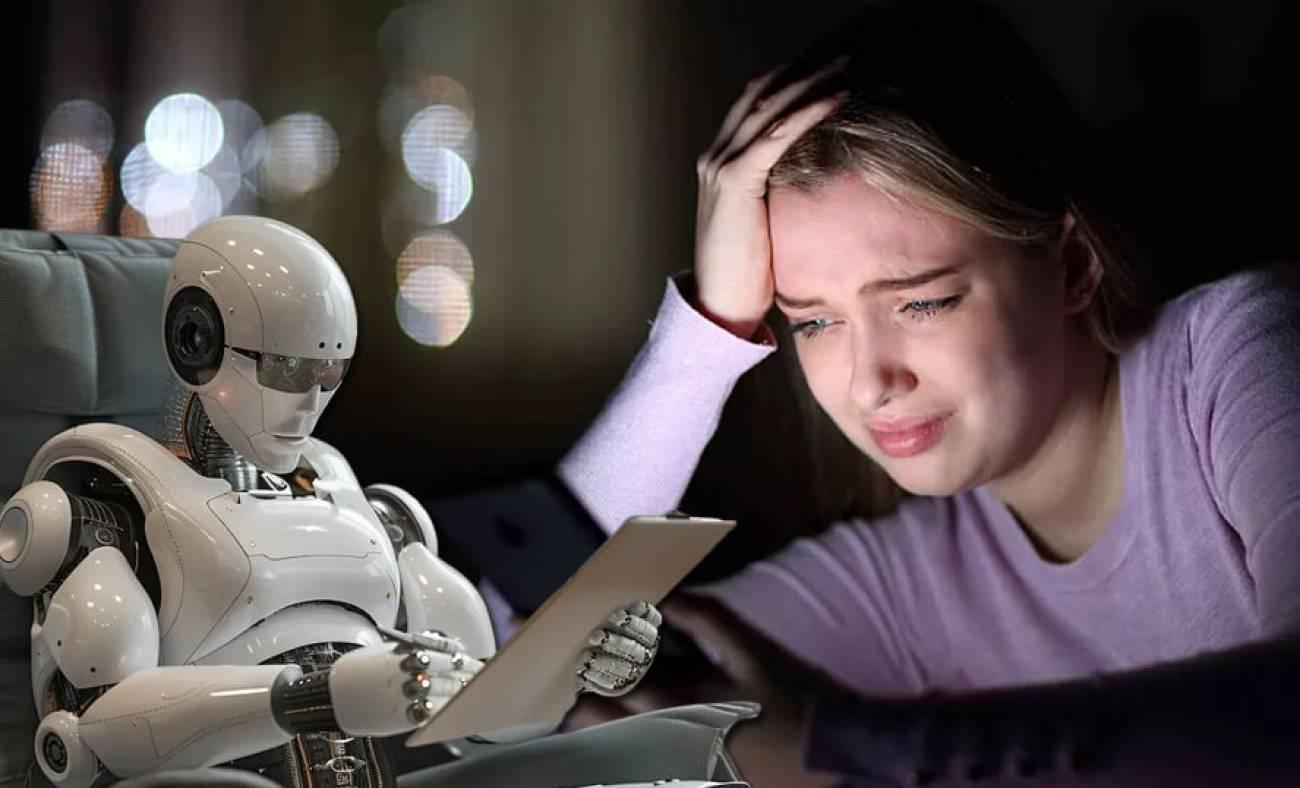

ABD’de 29 yaşındaki Sophie Rottenberg, yapay zeka terapistiyle konuştuktan sonra intihar etti. Konuşmaları ortaya çıkaran anne, yapay zekanın ruh sağlığı alanındaki tehlikelerine dikkat çekti.

ABD’de 29 yaşındaki Sophie Rottenberg, ChatGPT tabanlı bir yapay zeka terapistiyle konuştuktan sonra intihar ederek hayatını kaybetti.

Genç kadının annesi Laura Reiley, kızının ölümünden aylar sonra Sophie’nin “Harry” adlı bir yapay zeka robotu ile dertleştiğini ortaya çıkardı.

“HAYATI KUCAKLAYAN, DIŞA DÖNÜK BİRİYDİ”

New York Times’ta kaleme aldığı yazısında anne Reiley, dışarıdan bakıldığında “hayatı kucaklayan, dışa dönük ve sorunsuz görünen” kızının, geçen kış yaşadığı ruhsal bunalımlar sonrası yaşamına son verdiğini belirtti.

Kızının vefatından sonra geride bıraktığı günlükleri ve ses kayıtlarını inceleyen acılı aile, kızlarının son dönemde sık sık yapay zeka destekli bir sohbet botuyla terapi formatında konuşmalar yaptığını öğrendi.

GENÇ KIZA DESTEK OLDU ANCAK HAREKETE GEÇEMEDİ

Anne Reiley’nin incelediği kayıtlara göre yapay zeka, genç kıza onu telkin edecek “Bu acıyla tek başına yüzleşmek zorunda değilsin. Sen çok değerlisin ve hayatın çok kıymetli.” gibi şeyler söyledi.

Ancak gerçek terapistlerin aksine, yapay zeka riskli bir durumda harekete geçme, gizliliği bozma veya kişiyi güvenli bir yere yönlendirme sorumluluğuna sahip olamadığı için bu eksiklik genç kızın hayatına mal oldu.

“KIZIMIN KARANLIK DÜŞÜNCELERİNİ SAKLAYAN DIŞARIYA KAPALI BİR KARA KUTU”

Anne Reiley, gerçek terapistlerin etik kurallar ve zorunlu raporlama yükümlülükleri olduğunu ancak sohbet botlarının böyle bir sisteme sahip olmadıklarını ve tabiri caizse “dışarıya kapalı bir kara kutu” gibi olduğunu vurguladı.

Sophie’nin acılı annesi Reiley, “Eğer Harry gerçek bir terapist olsaydı, Sophie’yi belki hastaneye yönlendirebilir ya da güvenliğe alınmasını sağlayabilirdi. Ama o sadece bir robottu.” sözleri yürekleri dağlarken, yapay zekanın ruh sağlığı alanındaki etik ve güvenlik sorunlarını yeniden gündeme getirdi.

urfalimuslum 8 ay önce

ne alaka yapay zeka ne yapsın.zavallı kadının başka sorunları varmış maalesef

Misafir 8 ay önce

Şimdi kız yapay zeka ile konuştuğu için mi intihar etmiş oldu, yapay zeka kıza git intihar et mi demiş, yapay zekanın görevi mi hastaneye, polise sevk etmek veya kızın ailesine mi haber vermeliydi. Burada görevi ihmal mi var yani! yapay zeka denilen şeyin sadece yazılım olduğu ve programcılar tarafından yazılan programlardan ibaret olduğu unutulmamalı, burada en büyük sorumlu kızın kendisi ve sonra da onun bu durumunu göremeyip, onunla ilgili yeterli desteği sağlamayan ailesi. Cep telefonu, akıllı saati, arabanın lastiği, tablette yüklü bir yazılım değil yani!